La literatura internacional coincideix que la IA pot generar noves oportunitats educatives. Però que també pot debilitar la capacitat de judici propi, fer-nos més dependents respecte a les plataformes i els proveïdors, o ampliar i agreujar desigualtats si no s’acompanya.

A Catalunya, aquest debat s’obre en un moment rellevant, ja que el currículum d’educació bàsica incorpora el pensament computacional, la programació, la digitalització i l’esperit crític. Davant d’això, en aquestes línies que segueixen, intento respondre a una pregunta: “Hi ha oportunitats per treballar la intel·ligència artifical en l’educació? Què cal tenir en compte per evitar que reforci desigualtats?”

(0) Establir un punt de partida

El repte no és incorporar la tecnologia a l’educació, sinó definir quina relació educativa, cognitiva i política volem establir amb aquestes tecnologies, i en quines condicions poden ampliar oportunitats d’aprenentatge. Una relació que no s’acompanya amb capacitats crítiques, formes adequades de mediació i criteris de governança oriendes a l’equitat pot ampliar desigualtats.

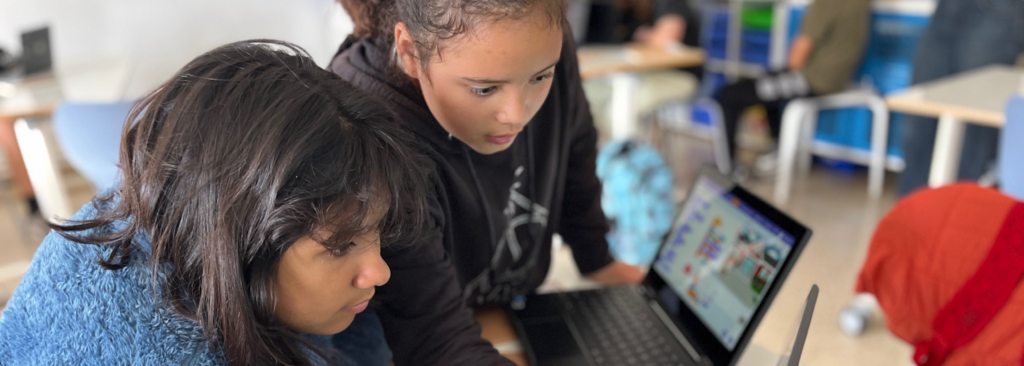

En aquest sentit, l’educació en IA i en entorns digitals ha d’integrar l’aprenentatge tècnic amb el desenvolupament de capacitats humanes, incloent el pensament crític entès en termes capacitat de comprendre, qüestionar i actuar amb criteri.

La discussió educativa sobre IA ha d’anar més enllà del “bon ús” i incorporar una comprensió crítica de com aquesta tecnologia es dissenya, es desplega i es governa.

Alhora, cal reconèixer que els usos de la tecnologia no depenen només dels individus, sinó també de les relacions educatives i de les condicions institucionals i tecnològiques en què es produeixen. És en aquesta intersecció entre competències, mediació i governança on es determina si la digitalització amplia oportunitats o reprodueix desigualtats.

Des d’aquí, podem identificar tres àmbits clau de repte i oportunitat per evitar que la introducció de la IA reforci desigualtats existents.

(1) Promoure una alfabetització crítica en IA orientat a l’autonomia i la criticitat

L’ús habitual d’eines d’IA no garanteix, per si sol, comprensió ni criteri, i pot afavorir tant formes de delegació cognitiva com relacions de dependència. Aquest risc es veu reforçat per decisions de disseny que fan que aquests sistemes adoptin formes conversacionals, personalitzades i aparentment empàtiques, generant una sensació de proximitat, comprensió i autoritat.

En aquest context, l’alfabetització en IA no es pot limitar a l’ús funcional de les eines. Ha d’incloure la comprensió del seu funcionament, l’anàlisi dels seus límits i la capacitat de qüestionar els valors, interessos i relacions de poder que incorporen. Això implica desenvolupar el pensament crític entès no només com un conjunt d’habilitats cognitives, com l’anàlisi o l’avaluació, ni tampoc únicament com un esperit crític que en promogui l’ús, sinó en termes de criticitat.

És a dir, formar persones capaces no només de comprendre i qüestionar la informació, sinó també de posicionar-se i actuar amb criteri en contextos travessats per relacions de poder, interessos i valors.

Alhora, és necessari desenvolupar capacitats que permetin no només moure’s dins dels sistemes existents, sinó també imaginar i construir alternatives en la manera de dissenyar, governar i utilitzar la tecnologia. Sense aquesta dimensió, l’educació corre el risc de formar usuaris adaptatius, capaços de funcionar correctament dins del sistema, però amb poc marge per qüestionar-lo i transformar-lo.

(2) Construir mediacions adultes no punitives

Un segon repte té a veure amb la manera com famílies i centres educatius acompanyen les experiències digitals d’infants i adolescents. Quan aquestes es gestionen des de la por al càstig, augmenta l’ocultació i es redueixen tant la protecció com la possibilitat d’intervenció educativa.

Gran part dels riscos associats als entorns digitals tenen a veure tant amb les pràctiques individuals com amb el disseny de plataformes orientades a captar l’atenció, fomentar la connexió permanent i dificultar la distància crítica. En aquest context, les respostes basades en la prohibició o la sanció resulten insuficients i poden, a més, reforçar dinàmiques d’ús ocultes i menys accessibles a l’acompanyament educatiu.

Per això, el repte no és només regular o limitar l’ús, sinó construir formes de mediació que permetin comprendre, contextualitzar i donar sentit a aquestes experiències. Això implica reforçar el paper de docents, centres i famílies com a referents capaços d’acompanyar des de la confiança, la conversa i la corresponsabilitat, i no principalment des de la reacció punitiva.

Aquesta dimensió té una implicació directa en l’equitat, ja que les possibilitats d’acompanyament no es distribueixen de manera homogènia. Les diferències en capital digital, temps, coneixements i recursos condicionen la capacitat de sostenir una mediació educativa de qualitat. Sense una acció deliberada, això pot traduir-se en experiències digitals més guiades i significatives en alguns contextos, i més desregulades o vulnerables en d’altres.

(3) Incorporar la governança dels sistemes digitals a l’agenda educativa

Un tercer àmbit de repte és la governança. Els riscos i impactes educatius de la digitalització i de la IA estan fortament condicionats pel disseny de plataformes, algoritmes i interfícies, que orienta i incentiva determinades formes d’ús per part d’infants i adolescents. La tecnologia no és un instrument neutral: incorpora arquitectures i lògiques de funcionament que promouen pràctiques, decisions i maneres de relacionar-se amb la informació, amb els altres i amb el temps d’atenció.

És imprescindible que les decisions sobre la incorporació de la IA a l’educació responguin a criteris pedagògics i no a dinàmiques de pressió.

Quan el focus se situa només en la responsabilitat individual de l’usuari, queden fora de camp qüestions estructurals com l’opacitat dels sistemes, la captació i tractament de dades, els biaixos, la dependència dels proveïdors tecnològics o la manera com aquestes arquitectures condicionen oportunitats d’aprenentatge i marge d’autonomia. Per això, la discussió educativa sobre IA ha d’anar més enllà del “bon ús” i incorporar una comprensió crítica de com aquesta tecnologia es dissenya, es desplega i es governa.

Això situa en primer pla qüestions com la transparència, els drets digitals, la privacitat, la traçabilitat, la responsabilitat tecnològica i la capacitat de les institucions educatives de decidir amb criteri propi sobre les eines que adopten i els impactes que poden generar. Des d’una perspectiva d’equitat, aquesta dimensió és central, ja que els centres amb menys capacitat institucional poden quedar més exposats a adopcions acrítiques, dependències tecnològiques o eines inadequades, amb menys marge per supervisar-ne els impactes i negociar-ne les condicions d’ús.

En aquest sentit, és imprescindible que les decisions sobre la incorporació de la IA a l’educació responguin a criteris pedagògics i no a dinàmiques de pressió, modes tecnològiques o narratives d’innovació acrítica. El desplegament d’aquestes eines sovint s’acompanya de discursos impulsats per interessos comercials i lògiques de mercat que no sempre coincideixen amb les necessitats educatives. Per això, cal reforçar la capacitat de les institucions educatives per discernir amb criteri propi, assegurant que l’adopció de tecnologies digitals i d’IA estigui guiada per finalitats educatives, criteris d’equitat i responsabilitat pública.

La qüestió central són les condicions amb les què la IA es desplega

Per tant, el repte d’equitat en la incorporació de la IA a l’educació catalana no es defineix per la disponibilitat de tecnologia, sinó per les condicions en què es desplega i s’utilitza.

Les desigualtats es configuren en tres nivells interrelacionats: entre l’alumnat que sap utilitzar la IA de manera autònoma, crítica i estratègica per ampliar el seu aprenentatge i aquell que en fa un ús més passiu o dependent; entre els entorns capaços de sostenir formes d’acompanyament educatiu consistents i aquells on aquestes mediacions són més febles; i entre els centres amb capacitat per decidir i orientar l’ús de les tecnologies i aquells més exposats a dependències i adopcions acrítiques.

Quan no es garanteixen condicions d’ús orientades a l’aprenentatge significatiu, acompanyament educatiu i capacitat institucional per governar les tecnologies, es consolida una divisió entre alumnat de primera i de segona, incompatible amb el dret a una educació de qualitat en condicions d’equitat.

En aquest escenari, la qüestió central és en quines condicions s’incorporen aquestes tecnologies i amb quines garanties.

Això exigeix orientar les decisions educatives i tecnològiques a criteris d’equitat, reforçar deliberadament les capacitats i les mediacions allà on són més febles, i assegurar que els centres disposin del marge necessari per governar-ne l’ús.

Mireia Vendrell

Mireia Vendrell